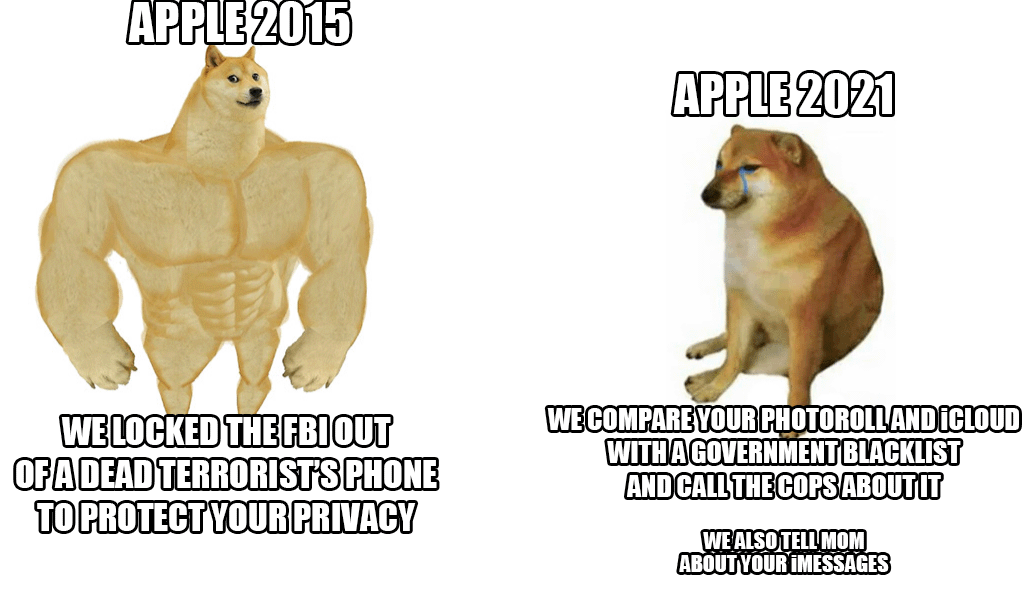

I slutningen af sidste uge afslørede Apple et nyt anti-børnemisbrugssystem, der vil scanne stort set alles iCloud-billeder. Selvom ideen lyder god ved første øjekast, da børn virkelig skal beskyttes mod denne handling, blev Cupertino-giganten alligevel kritiseret af en lavine – ikke kun fra brugere og sikkerhedseksperter, men også fra medarbejdernes rækker selv.

Ifølge de seneste oplysninger fra et respekteret bureau Reuters en række medarbejdere udtrykte deres bekymring over dette system i en intern kommunikation på Slack. De skulle angiveligt være bange for mulige overgreb fra myndigheder og regeringer, som kunne misbruge disse muligheder, for eksempel til at censurere personer eller udvalgte grupper. Afsløringen af systemet udløste en stærk debat, som allerede har over 800 individuelle beskeder inden for førnævnte Slack. Medarbejderne er kort sagt bekymrede. Selv sikkerhedseksperter har tidligere gjort opmærksom på, at det i de forkerte hænder ville være et rigtig farligt våben, der bruges til at undertrykke aktivister, deres nævnte censur og lignende.

Den gode nyhed (indtil videre) er, at nyheden kun starter i USA. I øjeblikket er det ikke engang klart, om systemet også vil blive brugt i EU-landene. På trods af al kritik står Apple dog ved sig selv og forsvarer systemet. Han hævder frem for alt, at al kontrol foregår inde i enheden, og når der først er et match, så bliver sagen først i det øjeblik kontrolleret igen af en Apple-medarbejder. Kun efter hans skøn vil det blive udleveret til de relevante myndigheder.

Det kunne være interesserer dig

Jeg ville nødig skifte fra iCloud til noget sikkert og virkelig privat, men hvis Apple insisterer, stopper jeg alligevel med at betale dem.

Den vil (indtil videre) kun være aktiv i USA

Det er lige meget, hvor det vil gælde lovgivningsmæssigt. Den teknologi vil allerede være derude og implementeret. Det er den største risiko.